Desde 2024, la Fundación Wikimedia ha registrado un aumento inesperado en la demanda de contenido multimedia almacenado en Wikimedia Commons, su repositorio abierto con más de 144 millones de archivos almacenados.

Según ha informado la propia organización en su blog oficial: «Nuestros sitios web son un destino inestimable para las personas que buscan información y para todo tipo de empresas que acceden automáticamente a nuestros contenidos como aportación fundamental a sus productos. Sobre todo, el contenido ha sido un componente fundamental de los resultados de los motores de búsqueda, lo que a su vez ha hecho que los usuarios vuelvan a nuestras páginas web». Sin embargo, añaden: «Pero con el auge de la IA, la dinámica está cambiando: estamos observando un aumento importante del volumen de solicitudes, y la mayor parte de este tráfico está impulsado por bots de ‘scraping’ que recopilan datos de entrenamiento para grandes modelos lingüísticos (LLM) y otros casos de uso».

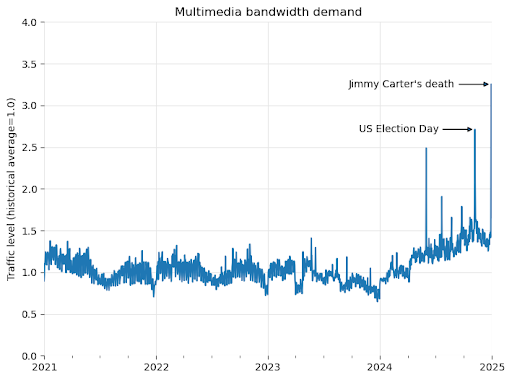

Este fenómeno ha provocado un aumento de hasta el 50% en el uso de banda ancha desde enero, un hecho que crea una presión constante sobre la infraestructura técnica de la fundación Wikipedia. La actividad de los bots es fácilmente detectable, ya que no diferencian entre entradas populares o nichos muy poco transitados. Estos bots fuerzan a los servidores a responder constantemente a sus demandas, elevando los costos operativos de la fundación. Sobre este tema, en el blog oficial han declarado: «Mientras que los lectores humanos tienden a centrarse en temas específicos, a menudo similares, los robots rastreadores tienden a «leer en masa» un mayor número de páginas y a visitar las entradas menos populares. Esto significa que es más probable que este tipo de peticiones se reenvíen al centro de datos centrales, lo que encarece mucho el consumo de nuestros recursos».

Esta problemática se pudo observar tras la muerte de Jimmy Carter

Un claro caso en el que se vivieron caídas a causa de los bots automatizados fue en diciembre del año 2024, cuando murió el expresidente de Estados Unidos Jimmy Carter. Aunque esta noticia, al ser un personaje importante, atrajo más de 2,8 millones de visitas en su página de Wikipedia en un solo día, el verdadero problema técnico tuvo lugar a causa de un gran volumen de descargas del debate de 1980 entre Carter y Reagan; este gran volumen de tráfico saturó la página web temporalmente. Aunque el equipo de confiabilidad de Wikipedia logró redirigir el tráfico para evitar la caída, el incidente dejó clara la fragilidad del sistema ante usos intensivos automatizados.

De acuerdo con el informe presentado por Wikipedia, al menos el 65% del tráfico que más consume son bots: «Descubrimos que al menos el 65% de este tráfico que consume recursos del sitio web procede de bots, una cantidad desproporcionada si se tiene en cuenta que las páginas vistas por bots representan alrededor del 35% del total. Este elevado uso también está causando constantes trastornos a nuestro equipo de fiabilidad, que tiene que bloquear el tráfico abrumador de estos rastreadores antes de que cause problemas a nuestros lectores». Este dato revela el claro desequilibrio entre el valor que obtiene Wikipedia a través de los bots de IA y el costo que estos causan a la fundación sin ánimo de lucro.

Frente a esta problemática, Wikipedia, en su borrador del plan anual 2025 bajo el eje «WE5: Uso responsable de la infraestructura«, plantea la necesidad de establecer directrices para el acceso automatizado a sus contenidos. “Nuestro contenido es gratuito, pero nuestra infraestructura no”, afirma el documento.

Abre un paréntesis en tus rutinas. Suscríbete a nuestra newsletter y ponte al día en tecnología, IA y medios de comunicación.