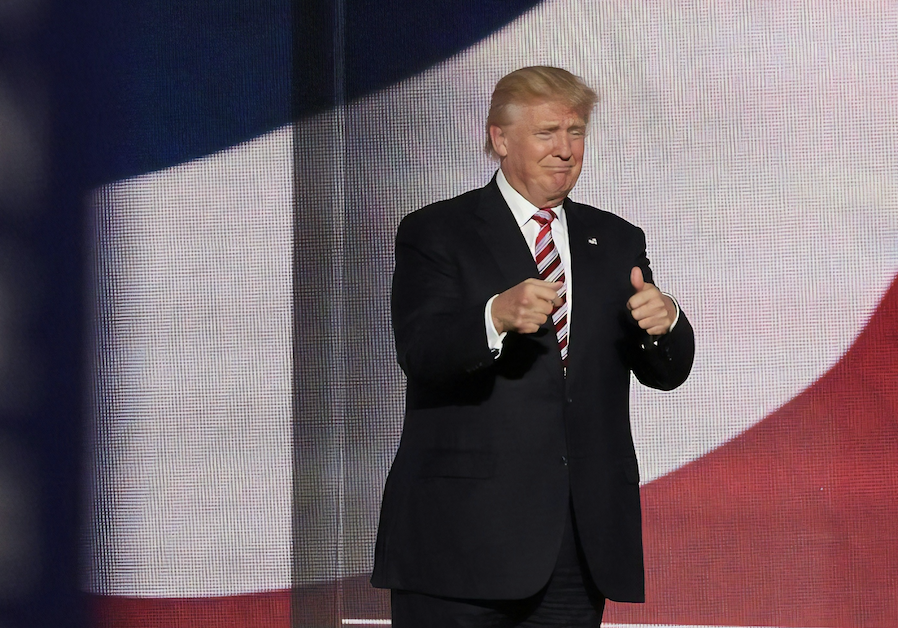

El presidente de Estados Unidos ha cambiado las reglas del desarrollo de la IA: desaparece cualquier referencia a la seguridad y la equidad

El Instituto Nacional de Estándares y Tecnología (NIST) ha emitido nuevas directrices que marcan un giro en la estrategia de investigación en inteligencia artificial en Estados Unidos. Las instrucciones eliminan las referencias a «seguridad de la IA», «IA responsable» y «equidad en la IA», y centran la atención en reducir el «sesgo ideológico» y promover la competitividad económica del país.

Anteriormente, las directrices promovían el desarrollo de herramientas para identificar y corregir comportamientos discriminatorios en modelos de IA, especialmente en aspectos relacionados con género, raza, edad o desigualdades económicas. Estos elementos eran importantes para evitar que los sistemas de IA perpetuaran injusticias sociales. Pero, con la eliminación de esto, la preocupación ha crecido.

La influencia de Elon Musk y la agenda de «America First»

El cambio en las directrices también refleja una orientación política más amplia bajo la administración Trump. Elon Musk, quien lidera el Departamento de Eficiencia Gubernamental (DOGE), ha influido en esta nueva narrativa. Musk ha sido crítico de los modelos de IA desarrollados por empresas como OpenAI y Google, a las que acusa de estar «sesgadas ideológicamente» y ser «políticamente correctas».

DOGE ha implementado medidas como despidos masivos y recortes presupuestarios en agencias como el NIST. Esto ha creado un ambiente hostil para quienes puedan oponerse a los objetivos del gobierno actual. La nueva medida prioriza el «florecimiento humano» y la competitividad global, conceptos que han sido calificados de vagos e indefinidos por algunos investigadores.

Preocupaciones sobre la imparcialidad y la seguridad en la IA

Las nuevas directrices han levantado críticas en ámbitos como el académico y el científico. Investigadores que han querido mantener el anonimato han advertido que ignorar la seguridad y la equidad en la IA podría tener consecuencias para los usuarios finales, ya que permite que algoritmos discriminatorios pasen desapercibidos. “Esto podría conducir a un futuro en el que la IA sea injusta, insegura y se despliegue sin responsabilidad”, señaló uno de los expertos.

También, la eliminación de métodos para autenticar contenido y rastrear su procedencia indica una menor preocupación por combatir la desinformación y los ‘deepfakes’, y podría facilitar la propagación de informaciones falsas.

El futuro de la IA en Estados Unidos

La eliminación del énfasis en seguridad y equidad plantea preguntas sobre la responsabilidad social en el desarrollo tecnológico. Estados Unidos busca mantener su liderazgo en el campo de la IA, pero queda por ver cómo estas nuevas directrices influirán en la investigación y el desarrollo a largo plazo.

Foto de History in HD en Unsplash

Abre un paréntesis en tus rutinas. Suscríbete a nuestra newsletter y ponte al día en tecnología, IA y medios de comunicación.