Hoy se ha producido la esperada inauguración de la ‘Exhibition’ y he empezado el día asistiendo a un curso sobre Inteligencia Artificial multimodal. Ha estado muy bien. Unos portátiles MSI con intel core i9 y tarjeta nVIDIA RTX para que las cosas fueran ligeras… En esta página tenéis acceso a varios cursos, la mayoría gratuitos (para algunos sí hay que pagar por el coste de acceso a los servicios ‘cloud’ que procesan las peticiones).

De entre mis sesiones del día, he escogido también otra de IA generativa, con unos ‘papers’ interesantísimos sobre maneras de controlar los resultados que nos dan los transformers: unos nodos de control, permiten encaminar los resultados hacia la dirección deseada.

También he podido asistir a una sesión organizada por el Metaverse Standards Forum, donde los miembros del foro han hablado sobre sus proyectos de este año y los planes de futuro.

Otra sesión interesante ha sido la organizada por HTC Vive titulada «Breaking the model: democratizing access to immersive environments», donde se ha explicado la diferencia entre el streaming de pixels y el streaming de geometría, el repaso a los diferentes servicios que existen y la propuesta de HTC con ‘Viverse’ para democratizar el acceso a entornos inmersivos usando streaming de geometría.

Almacenamiento

La última sesión a la que he podido ir ha sido una puesta en común de personas interesadas en temas de almacenamiento. Cuando el ponente pregunta quién tiene más de 20 PetaBytes en su almacenamiento, y levantan la mano varias personas, sabes que tienes mucho que aprender… Para vuestra información: la pregunta ha empezado por «¿quién gestiona menos de 250 TeraBytes?».

Inauguración de la ‘Exhibition’

Y es que hoy hemos cruzado el ecuador del SIGGRAPH 2024, porque por la mañana ha abierto la Exhibition, y las cosas cambian un poco. Ciertamente la exhibition ya no es lo que era hace veinte, o incluso diez años, porque es mucho más pequeña que entonces, pero sigue siendo un gran dinamizador de la conferencia. Las compañías muestran sus productos, y se desarrolla mucho ‘networking’. Hay sesiones formativas, charlas y demos de producto. Compartiré un vídeo dentro de unos días, cuando lo edite, para que podáis experimentar lo que es la ‘Exhibition’ las personas que no hayáis ido nunca al SIGGRAPH.

También se ha abierto la Art Gallery, la Job Fair, y la siempre apetecible Emerging Technologies, donde podemos ver los últimos trabajos que están desarrollando en laboratorios de empresas y universidades de todo el mundo, y se presentan prototipos.

El efecto holográfico en una pantalla volumétrica

Me ha gustado un prototipo de pantalla volumétrica, basada en técnicas holográficas, y que por supuesto poco tiene que ver con los falsos hologramas que se comercializan como tales sin serlo. Muy interesante también el sistema de videoconferencia con pantalla volumétrica de Google, al que aún no he podido ir este año, porque había una cola inmensa para acceder a él. Muy vistosa también la aplicación de la empresa japonesa de telecomunicaciones NTT para visualizar cómo quedaría el vestuario en condiciones de iluminación diferentes.

Dava Newman, del MIT Media Lab, ha hablado sobre si estamos solos, sobre la habitabilidad de los planetas, y sobre el traje espacial que diseñó para la NASA, entre otras cosas. Un keynote excelente.

Y la última sesión de hoy ha sido el ‘Real Time Live!’. «¡Cómo pasa el tiempo!», porque nada más y nada menos que 14 ediciones se han celebrado ya de este formato en el que lo que se muestra en pantalla se genera en tiempo real, desde cero. No hay vídeos pregrabados, y alguna vez incluso se pueden ver los errores en directo. No ha sido el caso hoy, que ha funcionado todo muy bien. La primera sesión ha resultado ser un concierto en directo con gráficos en la pantalla LED y aumentado en AR con gafas VR, la segunda sobre marionetas digitales, y hemos podido ver incluso un escenario que se ha construido a base a prompts que «hablan» con OpenUSD para generar el contenido, en éste último caso, a cargo del equipo de técnicos de nVIDIA.

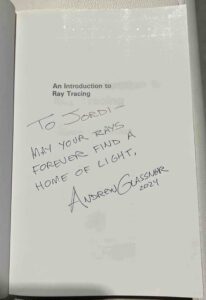

A título personal, he podido coincidir con Andrew Glassner, uno de los grandes, y me ha dedicado uno de sus libros. Los recomiendo todos. Hace poco publicó uno sobre Deep Learning, y en unos meses sale a la venta su último libro sobre Quamtum Computing.

Jordi Alonso – Enviado especial a SIGGRAPH para Paréntesis MEDia