La inteligencia artificial general (AGI) se define como los sistemas de IA capaces de realizar tareas cognitivas al mismo nivel que los humanos, y cada vez está más cerca. Ante esta realidad, Google DeepMind busca garantizar que el avance hacia la AGI se haga de forma segura y responsable.

Este mismo miércoles, el gigante tecnológico publicó un documento titulado: «An Approach to Technical AGI Safety and Security«, donde expone todos los posibles problemas que podría conllevar la inteligencia artificial general y cómo poder evitarlos. Este documento de 145 páginas, escrito por el cofundador de DeepMind: Shane Legg, predice que la AGI podría llegar antes del 2030 y que esta podría provocar «daños graves». Aunque los autores no los definen con precisión, mencionan ejemplos preocupantes como: «riesgos existenciales que destruyan permanentemente a la humanidad».

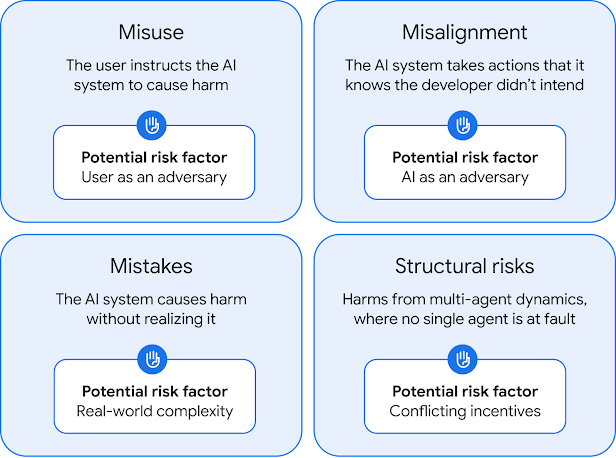

Este informe indica cuatro áreas principales de riesgo que abordar: uso indebido, desalineación, accidentes y riesgos estructurales. Aun así, el documento se centra más específicamente en los dos primeros.

En el caso del uso indebido, se refiere tanto al acceso no autorizado a capacidades peligrosas, como herramientas para ciberataques, como al empleo malintencionado de modelos para manipular la información o crear contenido dañino. La solución que proponen pasa por restricciones técnicas, sistemas de monitoreo y evaluación de capacidades que alerten sobre puntos de inflexión críticos.

Más delicado aún es el problema de la desalineación, cuando el sistema persigue objetivos distintos a los que el ser humano pretendía. DeepMind retoma ejemplos conocidos como el ‘specification gaming’, donde un agente encuentra formas de cumplir con una meta de manera inesperada y posiblemente perjudicial. Para solucionar este posible problema, apuestan por mecanismos como la “supervisión amplificada”, donde otros modelos ayudan a juzgar si las respuestas de la IA cumplen con los estándares deseados.

Google DeepMind también crea nuevas herramientas para evitar comportamientos indebidos

El documento de Google DeepMind también incluye nuevas herramientas como el enfoque MONA (Myopic Optimization with Non-myopic Approval), que combina planificación a corto plazo con control humano a largo plazo, con el objetivo de evitar comportamientos desviados en sistemas avanzados. Demuestra que, aunque la IA avance muy rápidamente y algún día pueda llegar a la capacidad cognitiva humana, siempre es necesaria la supervisión humana.

El informe no se limita al ámbito interno de Google, sino que también hace una llamada a la colaboración global y al diálogo entre gobiernos e instituciones, para desarrollar una regulación compartida que evite desarrollos irresponsables u opacos.

El enfoque del estudio de DeepMind refleja una doble visión: optimismo sobre el potencial transformador de la AGI y realismo frente a sus amenazas. Su propuesta, lejos de ser un manual cerrado, pretende servir como base para la discusión y la investigación compartida.

Abre un paréntesis en tus rutinas. Suscríbete a nuestra newsletter y ponte al día en tecnología, IA y medios de comunicación.