Ultimo día de conferencia. Las personas con perfil técnico tiramos más por las sesiones técnicas, pero SIGGRAPH es la conferencia donde confluyen arte y técnica, y hay una gran variedad de sesiones no tan técnicas, o incluso para introducirse en el mundo técnico si no se tiene el perfil.

En las Production Sessions, a las que hace muchos años que no voy y no por ello dejan de ser populares y muy concurridas, los artistas y técnicos que han trabajado en películas recientes explican con detalle cómo resolvieron algunos planos, le dieron personalidad a un personaje CGI o crearon un ambiente con luz y color para transmitir ciertas sensaciones. Este año se ha hablado de ‘Inside Out 2’ (‘Del revés 2’, explicado por Pixar), ‘Dune’ parte 2 (explicado por DNEG) y ‘Kung Fu Panda 4’ (explicado por DreamWorks).

También hay un track completo para educadores. Con contenidos específicos para profesorado que quiera aplicar computer graphics, tecnologías interactivas o inteligencia artificial en sus clases.

El día ha empezado a las 8:00 con la sesión: Immersive Visualisation for Science, Research, Art and Digital Twins Applications. Seis ponentes distintos han comentado cómo usan la visualización inmersiva en sus centros.

La siguiente sesión a la que he ido ha sido una de seis papers técnicos titulada: Controllable image generation and completion. Muy interesante el hecho de que los prompts generan imágenes muy genéricas, y como mediante el nuevo concepto «Creative Generation», y filtros guiados, se puede dirigir la AI generativa a resultados más predecibles.

El siguiente curso al que he ido ha sido Video Generation. Muy interesantes las técnicas de movimiento de cámara o del sujeto de forma separada, o usar el movimiento de un vídeo para dirigir el movimiento en otro.

He hecho un paseo más por la exhibition, ¡y ha habido sorpresa! Los de Renderman han decidido hacer una visita al pasado y volver a repartir teteras… y claro… se ha montado una de las colas que hacía tiempo que no se veía, que suponía casi todo un extremo y la mitad del otro de la ‘Exhibition’.

Probamos la telepresencia volumétrica de Google

He aprovechado para entrar en la demo del proyecto Starline de Google. Un sistema de video conferencia con telepresencia volumétrica, que da una naturalidad sorprendente en reuniones uno a uno. Un sistema de múltiples càmaras y una pantalla que debe ser lenticular (no dejaban entrar cámaras ni respondían a preguntas técnicas), da una sensación de proximidad de la persona remota realmente sorprendente. Se pondrá a la venta a finales de este año, y puedo prever que barato no será.

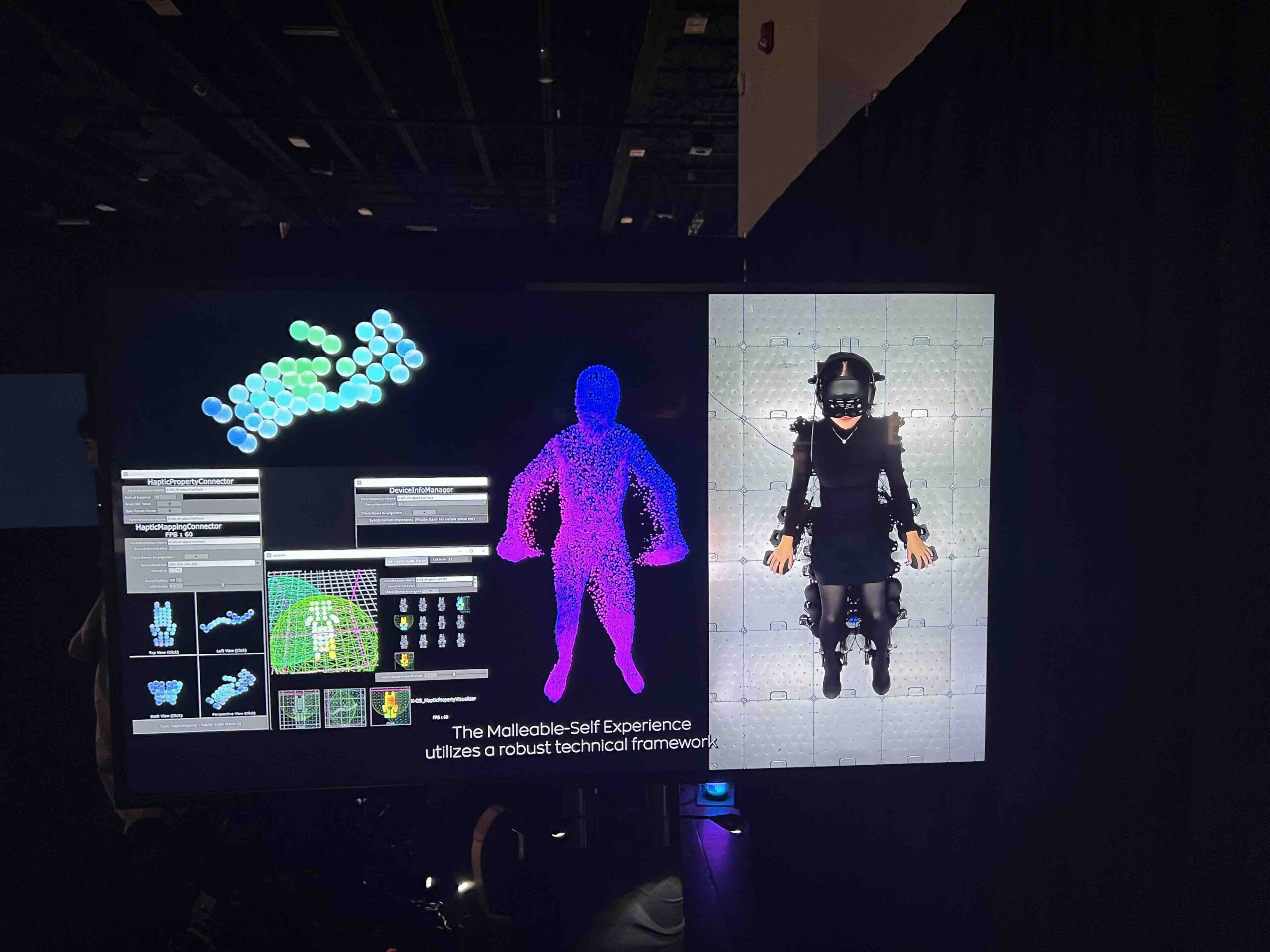

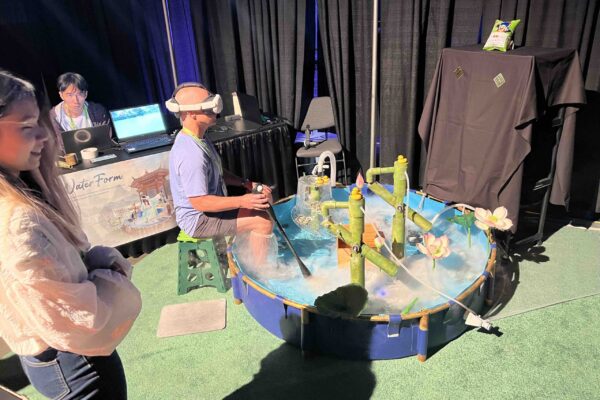

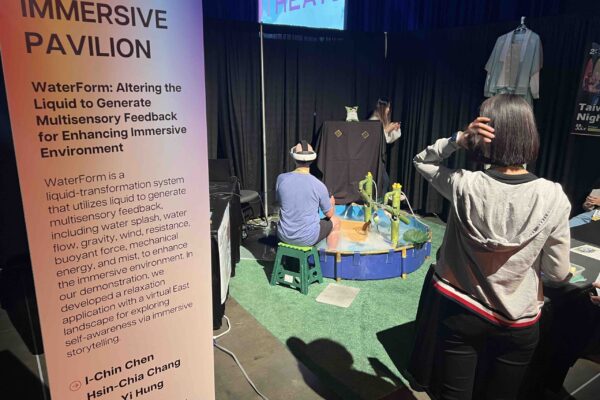

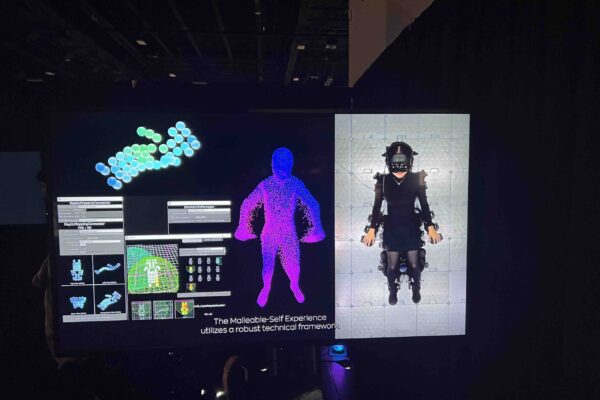

He vuelto a pasar por el Immersive pavilion y he visto con más detalles algunos de los proyectos allí mostrados:

Kinesway: simula las sensaciones de vibración de un terreno

No creo que en la universidad Carnegie Mellon hayan oído hablar de Soldamatic, porque XRWeld me parece lo mismo pero no se puede considerar una tecnología emergente porque hace al menos 6 años que lo tiene en el mercado una empresa andaluza.

Me ha sorprendido ver este proyecto: Waterform, que es multisensorial.

Este otro proyecto era un sillón casi horizontal con extrañas formas, que parece que relajaba a la persona que estaba tumbada en él.

HaptoRoom lleva la interactividad a otro nivel con un suelo que vibra.

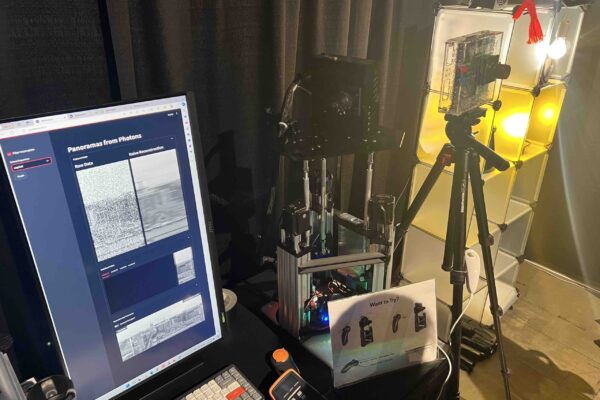

Las cámaras de 1 fotón, con unas características únicas como son un frame rate de 100.000 fps y que son casi inmunes a movimiento, a cambio de tener mucho ruído. Lo que se hace mediante técnicas de sobremuestreo, promediar imágenes para obtener una imagen nítida.

La última sesión a la que he asistido ha sido en conjunto de papers titulados conjuntamente: Generative Models for Visual Content Editing and Creation.

Ha sido otra de las sesiones sobre cómo controlar de forma más predictiva lo que se obtiene de una IA Generativa, y cómo gracias a ese control, también se obtiene una mejor calidad.

Y con esta sesión, se ha acabado el SIGGRAPH 2024.

Una última cosa que he querido hacer, ha sido comprobar si según el altímetro de mi móvil, era cierto que estábamos en la ciudad que está a 1 milla de altitud (1.609m)… pues aquí está la prueba:

Jordi Alonso, enviado especial al SIGGRAPH para Paréntesis Media.