La startup Deep Cogito, con sede en San Francisco, ha presentado su nueva familia de modelos de inteligencia artificial, Cogito 1, los cuales destacan por alternar entre modelos de razonamiento profundo y de respuesta rápida. Esta función les permite a los modelos manejar tanto tareas complejas como consultas simples.

Los modelos de razonamiento, como el O1 de OpenAI o el R1 de DeepSeek, destacan por realizar tareas complejas relacionadas con la ciencia o las matemáticas, debido a su capacidad para resolver problemas paso a paso. Sin embargo, este proceso suele implicar un mayor consumo de recursos y latencia. Por este motivo, Deep Cogito ha desarrollado un modelo híbrido, para optimizar recursos y proporcionar respuestas rápidas a consultas más sencillas y tomarse más tiempo mediante el modelo de razonamiento para consultas más extensas y complejas.

La serie Cogito 1 abarca modelos desde 3.000 millones hasta 70.000 millones de parámetros, con el objetivo de aumentar a 671.000 millones de parámetros en el futuro. El número de parámetros es un indicador aproximado de la capacidad de resolución de problemas de un modelo; cuantos más parámetros, más rendimiento.

Cogito 1 usa como base Llama y Qwen, pero innova en el método de entrenamiento

Cabe destacar que Cogito 1 no fue desarrollado desde cero, sino que se usaron como base los modelos abiertos de Llama (Meta) y Qwen (Alibaba), aplicando métodos de entrenamiento innovadores para mejorar su rendimiento y habilitar el razonamiento conmutado. El método de entrenamiento innovador, utilizado por Cogito 1, se llama: Iterated Distillation and Amplification (IDA), y se basa en un proceso de auto-mejora iterativa que permite a los modelos desarrollar capacidades más allá del umbral impuesto por sus supervisores humanos. Según explican, cada ciclo de IDA implica dos pasos: primero, se utiliza mayor capacidad computacional para resolver un problema de forma más inteligente (amplificación); después, ese conocimiento se “destila” en los parámetros del modelo. Este bucle se repite, generando una espiral de mejora que ya demuestra resultados.

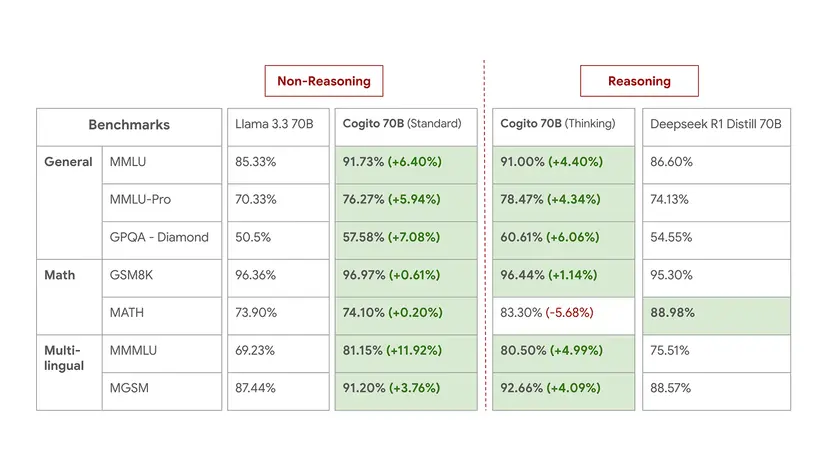

Según pruebas internas, el modelo más avanzado, Cogito 70B, supera al modelo R1 de DeepSeek en diversas evaluaciones de matemáticas y lenguaje cuando el modo de razonamiento está activado. Incluso con el razonamiento desactivado, Cogito 70B supera al reciente modelo de Meta: Llama 4 Scout en LiveBench, una prueba de IA de uso general.

El equipo humano detrás de Deep Cogito está formado por antiguos trabajadores de Google DeepMind y respaldado por el fondo de inversión South Park Commons. Los desarrolladores insisten en que Deep Cogito todavía se encuentra en su fase inicial de desarrollo. Sin embargo, la rapidez con la que han desarrollado esta familia de modelos, aproximadamente 75 días de desarrollo, sugiere una eficiencia fuera de lo común.