Gemma 3 ha recibido una actualización que mejora su accesibilidad y optimización, lo que permite a los usuarios ejecutar el modelo en sus propios dispositivos.

El mes pasado, Google DeepMind lanzó Gemma 3, su última generación de modelos de inteligencia artificial abiertos. Esta familia se distingue por poder funcionar en una sola GPU, lo que supuso un gran avance en accesibilidad y eficiencia. Ahora, Google ha anunciado una versión aún más accesible, optimizada con entrenamiento consciente de cuantización, conocido como QAT (Quantization-Aware Training). Esta nueva variante mantiene la misma calidad que sus predecesores, pero consume menos recursos. Según el anuncio oficial, esta mejora permite «ejecutar localmente modelos potentes como Gemma 3 27B en una GPU de consumo como la NVIDIA RTX 3090».

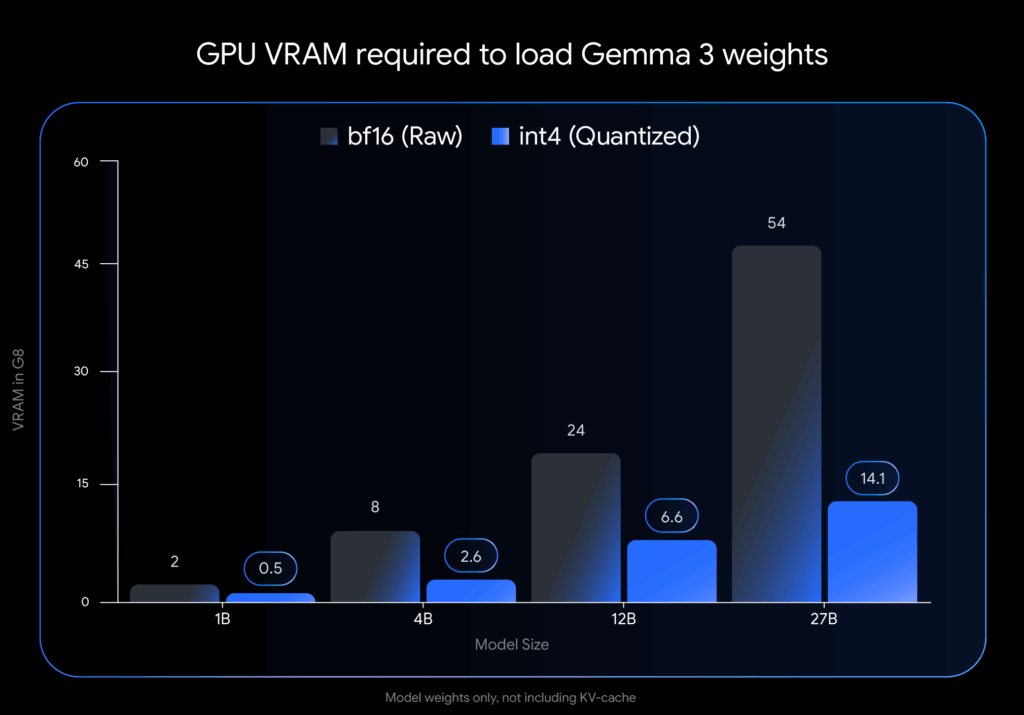

QAT introduce la cuantización desde las primeras fases del entrenamiento, lo que permite que el modelo se adapte a operar con menor precisión sin perder rendimiento. Por ejemplo, el modelo Gemma 3 27B, que antes necesitaba 54 GB de VRAM en formato BF16, ahora puede funcionar con solo 14,1 GB en formato int4. Así, los usuarios pueden ejecutarlo localmente con una GPU como la NVIDIA RTX 3090. El modelo intermedio, Gemma 3 12B, ya se puede usar eficientemente en portátiles con tarjetas gráficas como la NVIDIA RTX 4060, lo que facilita el uso de modelos grandes en equipos portátiles. Por último, el modelo más pequeño, Gemma 3 4B, funciona incluso en dispositivos con recursos limitados, incluidos teléfonos móviles.

Gemma 3 ya está disponible en plataformas como Hugging Face y Kaggle. También ofrece compatibilidad con herramientas populares como Ollama, LM Studio, MLX, llama.cpp y gemma.cpp. Este ecosistema permite que desarrolladores y entusiastas integren fácilmente los modelos en sus flujos de trabajo sin necesidad de realizar grandes cambios.

Con la optimización del modelo Gemma 3, que permite ejecutarlo en el entorno local, más que una mejora técnica es una declaración de principios. Democratizar el acceso a la IA de alto rendimiento puede ser una de las claves para equilibrar el desarrollo tecnológico en los próximos años.

Abre un paréntesis en tus rutinas. Suscríbete a nuestra newsletter y ponte al día en tecnología, IA y medios de comunicación.