Elizabeth Laraki explica a partir de su experiencia que no es lo mismo recortar una fotografía que ampliarla con IA, aunque «parezca igual de inocente»

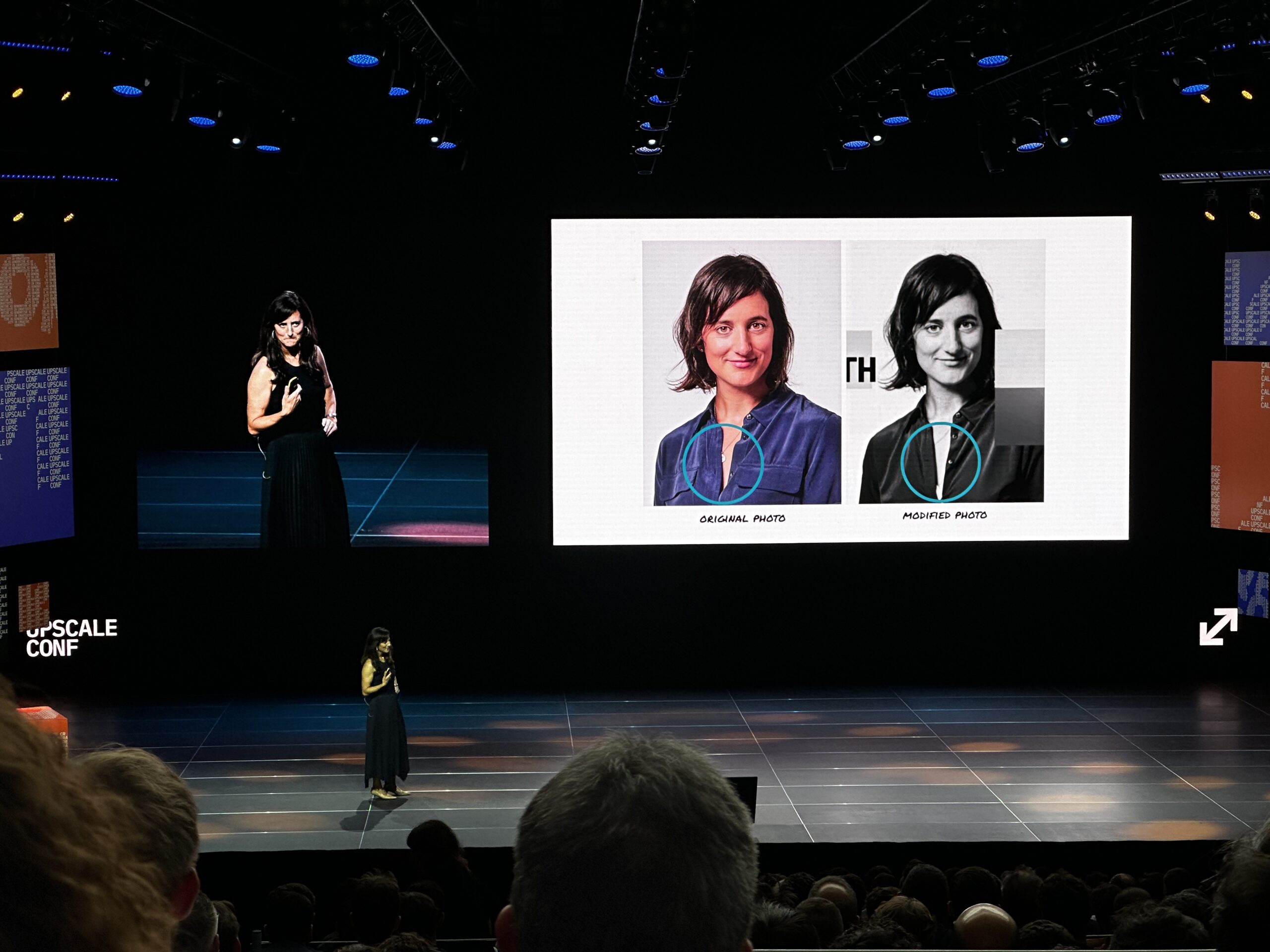

Una mañana a mediados de octubre, Elizabeth Laraki vio una foto suya promocionando la conferencia que le llamó la atención: «En la imagen parecía que mi sostén estaba a la vista y pensé, ‘¿ha estado visible en mi foto de perfil y nunca me había dado cuenta?’”. A partir de este descubrimiento, buscó la foto original, la que había enviado a la organización, y descubrió que la camisa aparecía abotonada.

«Me pareció muy extraño y me hizo sentir incómoda«, explica Laraki al relatar de nuevo los hechos ante todo el auditorio. ¿Qué había ocurrido realmente? Muy sencillo: un trabajador había usado la IA generativa para ampliar la imagen, sin percatarse del detalle que ofendió a la ponente.

Esta historia real ha servido de punto de partida para apuntalar dos ideas básicas, en las que Laraki ha insistido: la primera es que «la IA aún requiere juicio humano» y la segunda es que hay otras formas más tradicionales que podrían haber puesto solución al problema, como usar Photoshop o pedirle una nueva fotografía con el formato deseado. Sin embargo, la IA pareció ser la solución más rápida y económica.

Un problema que va más allá

Laraki también ha aprovechado para quitar hierro al asunto: «No hubo mala intención», aunque bien es cierto que debería informarse a la persona de que se va a modificar una imagen con IA «para obtener su consentimiento».

También se trata de una cuestión de concepción: hay que dejar claro que no es lo mismo recortar una fotografía que ampliarla con IA, aunque «parezca igual de inocente». Aunque nadie preguntaría al propietario de la imagen si puede recortarla, cuando se añaden elementos generativos que pueden cambiar el sujeto ya se puede estar traspasando una línea.

Y, por último, el problema de la usabilidad: «Si alguien modifica una foto, es crucial que pueda ver claramente las áreas que se están alterando. Esto no siempre es posible con las interfaces de las herramientas actuales», afirma.

La dificultad de aprender a usar herramientas con IA

Laraki ha aprovechado para reflexionar sobre la curva de aprendizaje de la IA, que muchas veces se hace cuesta arriba. La dificultad de encontrar un buen prompt de texto para describir lo que se quiere generar, contar con la paciencia necesaria para iterar las veces que haga falta, y las limitaciones propias de los modelos.

Dentro de estas plataformas, existen funcionalidades que van mejorando poco a poco esta experiencia de usuario, como es por ejemplo la posibilidad de pintar y modificar elementos específicos sin alterar el resto de la imagen.

Independientemente de los retos que plantean las herramientas, la historia de Laraki es un ejemplo de que la IA no genera nada por sí misma. Son la interacción humana y la iteración los que acaban configurando el resultado.

Abre un paréntesis en tus rutinas. Suscríbete a nuestra newsletter y ponte al día en tecnología, IA y medios de comunicación.